Pada tahun 1865, ekonom Inggris William Stanley Jevons mengungkapkan sebuah paradoks yang hingga kini masih relevan.

Disebut dengan Jevons Paradox, teori ini menjelaskan bagaimana peningkatan efisiensi justru mendorong peningkatan konsumsi, bukan pengurangan penggunaan sumber daya.

Di era modern, konsep ini dapat diterapkan pada kecerdasan buatan (AI), khususnya Large Language Models (LLM) seperti GPT-4.

Saat LLM semakin murah, kita mungkin akan mendapati bahwa penggunaannya justru semakin meningkat, dan pada akhirnya, biaya infrastruktur dan operasional pun ikut naik.

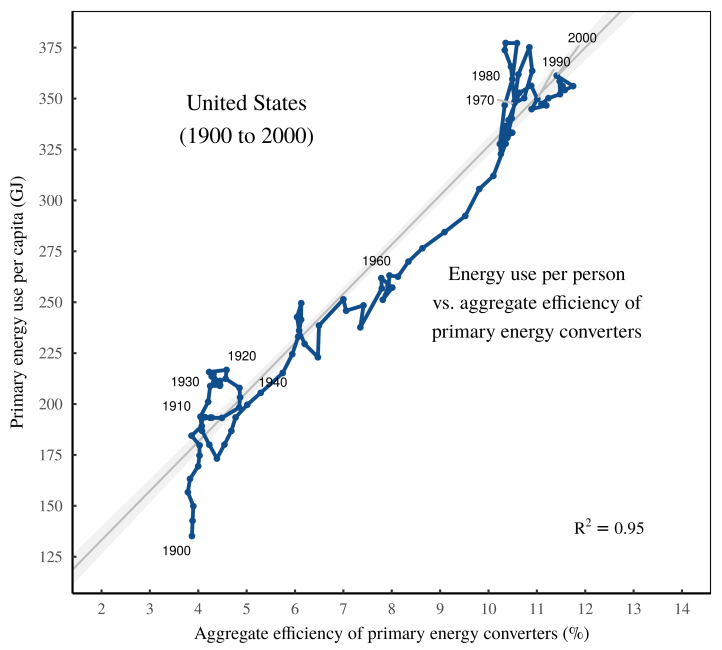

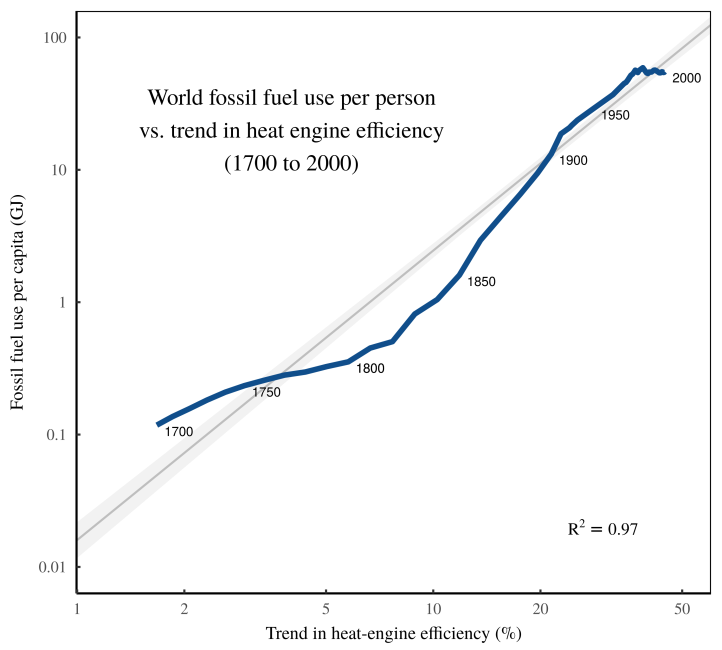

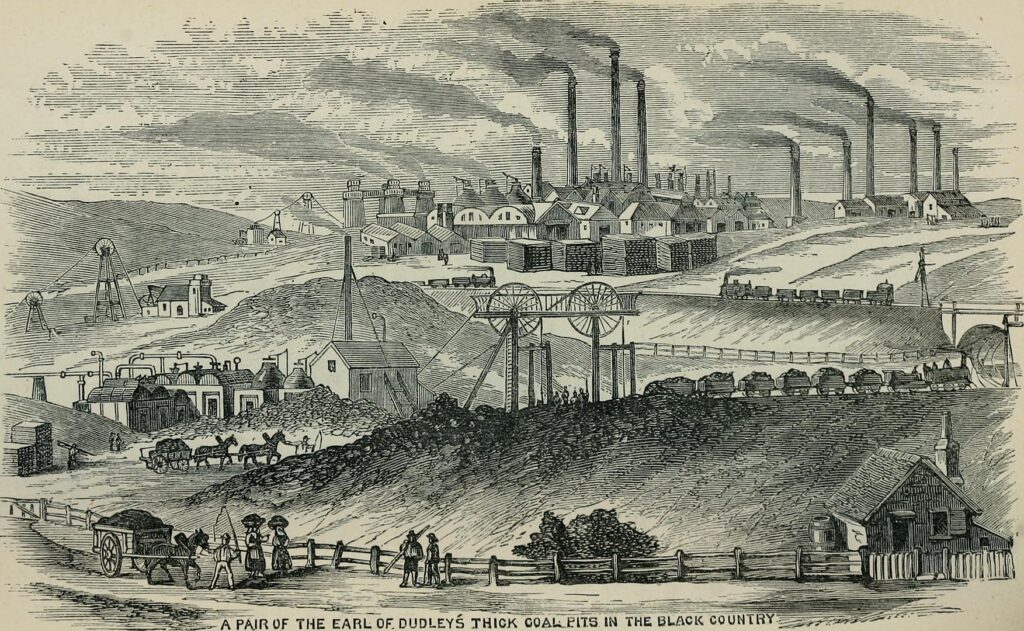

Secara historis, Jevons Paradox menunjukkan bagaimana kemajuan teknologi seperti mesin uap dan jaringan listrik membuat konsumsi energi lebih murah namun juga mendorong penggunaan yang lebih luas, sehingga potensi penghematan justru diimbangi dengan peningkatan permintaan energi secara keseluruhan.

Misalnya, meskipun teknologi hemat energi diperkenalkan, permintaan energi tetap melonjak karena biaya operasional yang lebih rendah dan akses yang lebih luas.

Saat ini, kita melihat tren yang serupa pada LLM dalam AI. Dalam setahun terakhir, biaya menjalankan model GPT-4 telah turun hampir 80%, membuat AI menjadi lebih terjangkau bagi berbagai organisasi.

Secara intuitif, seseorang mungkin mengira bahwa penurunan harga ini akan menghasilkan penghematan biaya AI yang signifikan, di mana perusahaan dapat mengalokasikan sumber daya untuk keperluan lain.

Namun, yang terjadi justru sebaliknya—fenomena yang mirip dengan Jevons Paradox.

Alih-alih mengurangi pengeluaran, AI yang lebih murah justru mendorong adopsi dan penerapan yang lebih luas dalam lebih banyak alur kerja.

Bisnis tidak hanya menggunakan AI untuk mengotomatisasi proses inti, tetapi juga memperluas penggunaannya ke area baru, seperti meningkatkan akurasi tugas-tugas yang sebelumnya terlalu mahal untuk diotomatisasi.

Paradoksnya adalah semakin murah AI, semakin banyak kita menggunakannya, dan pada akhirnya, biaya infrastruktur pun meningkat.

Organisasi kini tidak hanya menggunakan AI untuk menggantikan tugas manual.

Sebaliknya, mereka mendorong batas penggunaannya mengotomatiskan segala hal mulai dari layanan chatbot, layanan pelanggan hingga pembuatan konten dan analisis data secara realtime.

Penurunan biaya token AI dan akses model tidak selalu berarti pengurangan pengeluaran; melainkan, ini memberi peluang bagi perusahaan untuk menemukan cara-cara baru dalam mengintegrasikan AI ke dalam operasi mereka.

Semakin efisien AI, semakin banyak yang akan diotomatisasi, dan pada akhirnya ini dapat mendorong peningkatan kebutuhan infrastruktur.

Biaya infrastruktur, termasuk penyimpanan cloud, penggunaan GPU, dan jaringan, sering kali meningkat seiring dengan pertumbuhan penerapan AI.

Ketika organisasi memperluas beban kerja AI mereka, kemungkinan besar mereka akan menghadapi pengeluaran yang lebih tinggi terkait dengan penskalaan sistem mereka untuk menangani kebutuhan pemrosesan data yang lebih besar.

Selain itu, kebutuhan untuk interaksi AI secara real-time, pembaruan model yang berkelanjutan, dan peningkatan akurasi semakin meningkatkan biaya.

Paradoksnya, dengan membuat AI lebih murah, kita justru mendorong konsumsi AI yang lebih besar, yang pada gilirannya memerlukan investasi infrastruktur yang lebih besar.

Ambil contoh transisi dari agen layanan pelanggan manusia ke chatbot yang didukung oleh AI.

Seiring dengan turunnya biaya LLM seperti GPT-4, perusahaan mulai mengintegrasikan chatbot di setiap titik interaksi.

Namun, dengan ini datang peningkatan infrastruktur cloud untuk mendukung interaksi berbasis AI yang beroperasi 24/7, aliran data yang terus-menerus, dan kebutuhan untuk melatih model agar responsnya semakin akurat.

Apa yang awalnya dimaksudkan sebagai langkah penghematan biaya, justru dapat menyebabkan peningkatan pengeluaran infrastruktur dan operasional dalam jangka panjang.

Jevons Paradox mengingatkan kita bahwa tujuan dari teknologi bukanlah sekadar efisiensi, melainkan bagaimana kita mengelola peningkatan konsumsi yang datang seiring dengannya.

Prinsip yang sama berlaku untuk penggunaan LLM dan AI.

Ketika AI menjadi lebih murah dan lebih kuat, tantangan utama adalah memastikan bahwa organisasi menemukan keseimbangan yang tepat antara menggunakan AI untuk efisiensi dan mengelola biaya infrastruktur yang meningkat.

Tanpa pengelolaan konsumsi yang bijaksana, janji AI yang hemat biaya bisa berubah menjadi pengeluaran yang lebih besar di masa depan.

Rerensi :